Nvidia ra mắt H200 chip AI mạnh nhất thế giới

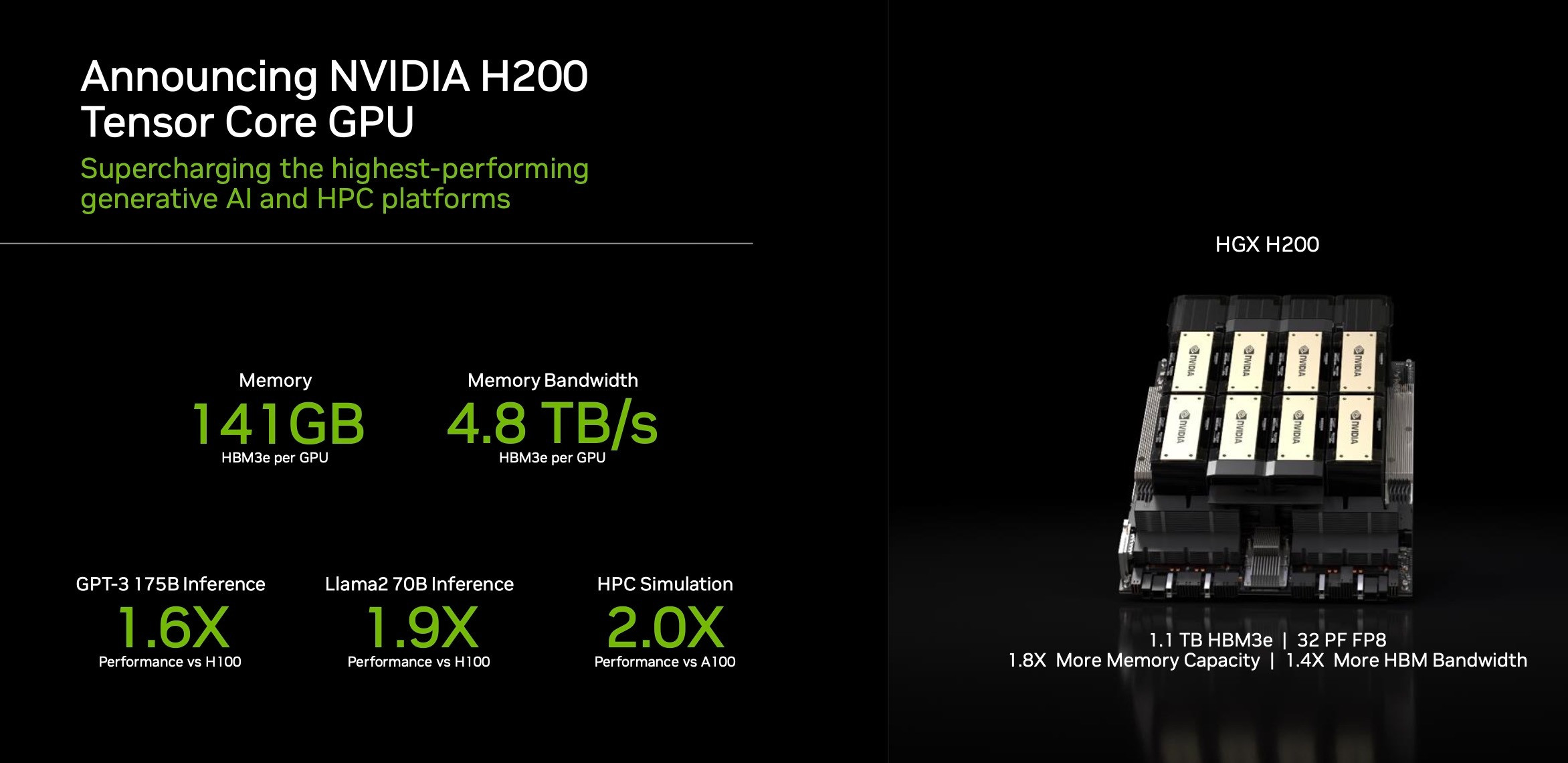

Nvidia H200 sẽ được ứng dụng trong các siêu máy tính và đào tạo AI, hứa hẹn mang lại hiệu suất gấp đôi so với mô hình H100 hiện tại. Sản phẩm này đã được công bố vào ngày 13/11 và dự kiến sẽ xuất hiện trên thị trường vào quý II/2024. Theo Nvidia, sự xuất hiện của H200 sẽ đánh dấu một bước đột phá về hiệu suất, đặc biệt là trong khả năng suy luận của các mô hình AI xử lý dữ liệu lớn.

Nvidia thực hiện thử nghiệm với mô hình ngôn ngữ lớn Llama 2 của Meta, có 70 tỷ tham số, và kết quả cho thấy H200 mang lại hiệu suất gần gấp đôi so với H100 - một trong những chip AI mạnh mẽ nhất hiện nay, được sử dụng rộng rãi trong các ứng dụng AI quan trọng như GPT-4 của OpenAI.

Mặc dù thông tin chi tiết về dòng GPU mới này chưa được công bố nhiều, nhưng Nvidia cho biết chúng đã được cải tiến đáng kể về dung lượng bộ nhớ và băng thông. H200 vẫn sử dụng kiến trúc Hopper như H100, nhưng đã nâng cấp lên bộ nhớ HBM3e dung lượng 141 GB và băng thông 4,8 TB/s, so với H100 sử dụng bộ nhớ HBM3 dung lượng 80 GB và băng thông 3,35 TB/s.

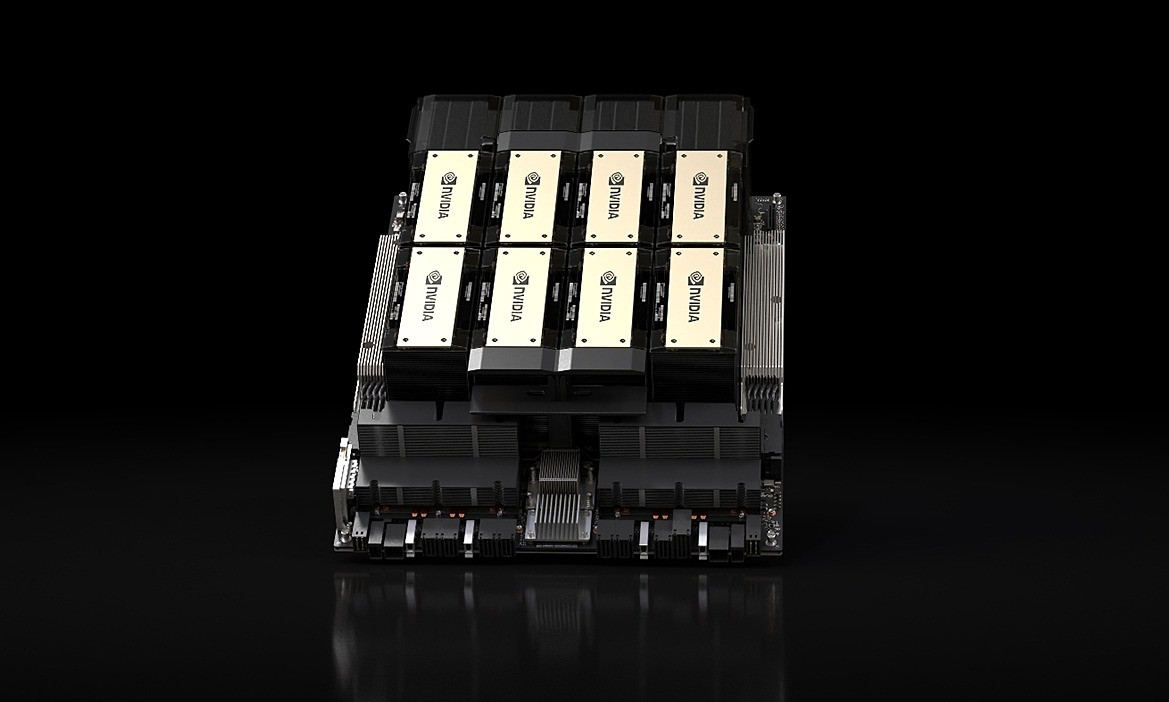

Mẫu chip mới này sẽ được tích hợp vào bo mạch Nvidia HGX với cấu hình bao gồm bốn hoặc tám GPU. Ngoài ra, Nvidia cũng cung cấp mô hình "siêu chip" GH200, kết hợp H200 và CPU Grace, với tổng cộng 624 GB bộ nhớ. Với cấu hình sử dụng tám GPU, HGX H200 có khả năng tính toán lên đến 32 petaflop mỗi giây. Điều đặc biệt là H200 tương thích với các hệ thống đã sử dụng H100 trước đó, giúp dễ dàng nâng cấp các hệ thống hiện tại.

Nvidia nhấn mạnh rằng H200 sẽ cải thiện hiệu suất làm việc của các hệ thống AI tạo sinh và các hệ thống điện toán hiệu năng cao (HPC), đồng thời giúp giải quyết những thách thức quan trọng nhất trong lĩnh vực này. Ian Buck, Phó chủ tịch Nvidia, nhấn mạnh rằng để tạo ra trí tuệ nhân tạo và điện toán hiệu năng cao, việc xử lý lượng lớn dữ liệu phải được thực hiện hiệu quả với GPU có bộ nhớ lớn và tốc độ cao.

Các đối tác đầu tiên của Nvidia, bao gồm Amazon Web Services, Google Cloud, Microsoft Azure và Oracle, sẽ tích hợp H200 vào các nền tảng điện toán đám mây của họ khi sản phẩm ra mắt vào năm sau. Theo thông tin từ Tomshardware, siêu máy tính Venado của Phòng thí nghiệm quốc gia Los Alamos (Mỹ) hoặc siêu máy tính Alps (Thụy Sĩ) có thể là những địa điểm đầu tiên sử dụng "siêu chip" GH200 của Nvidia.

Tính đến thời điểm hiện tại, Nvidia chưa công bố giá cả của H200, nhưng mẫu chip tiền nhiệm H100 đang là đối tượng săn đón của các công ty AI với mức giá từ 25.000 đến 40.000 USD.